Roberto Simanowski ist Kultur- und Medienwissenschaftler und lebt nach Professuren an der Brown University in Providence, der Universität Basel und der City University of Hong Kong als Medienberater und Buchautor in Berlin und Rio de Janeiro. Zu seinen Veröffentlichungen zum Digitalisierungsprozess gehören "Facebook-Gesellschaft" (Matthes & Seitz 2016) und "The Death Algorithm and Other Digital Dilemmas" (MIT Press 2018).

Das ethische Dilemma des technischen Fortschritts

04:46 Minuten

Stelle ich die Weiche um, wenn die Straßenbahn dadurch statt fünf nur einen Menschen tötet? Eine moralische Zwickmühle. Was aber, wenn technischer Fortschritt so eine Entscheidung erzwingt, fragt der Medienwissenschaftler Roberto Simanowski.

"Digital first, Bedenken second", so hieß im Bundestagswahlkampf 2017 der Slogan einer kleinen Partei, die dann beinahe das "Superministerium" für Bildung und Digitalisierung bekommen hätte – hätte sie nicht plötzlich die Koalitionsverhandlungen platzen lassen.

Glücklicherweise wussten andere schon damals, dass die umgedrehte Reihenfolge viel besser ist – oder zumindest das Bedenken die Digitalisierung begleiten sollte. Deshalb beschäftigen sich seit längerem Konferenzen, Kommissionen und Gutachten mit den gesellschaftlichen Folgen der digitalen Technologien.

Und immer häufiger geht es dabei um künstliche Intelligenz. Ein Beispiel ist die Kommission, die der deutsche Verkehrsminister 2016 einsetzte, um die ethischen Fragen selbstfahrender Autos zu klären. Der Abschlussbericht betonte, dass es im Falle eines Unfalls keine "Aufrechnung von Opfern" nach Anzahl, Alter oder Geschlecht geben darf. Das Leben eines Kindes ist nicht mehr wert als das eines Senioren, zwei Menschen - nicht mehr als einer.

Aus eben diesem Grund kassierte das Verfassungsgericht 2006 das vom Bundestag verabschiedete Luftsicherheitsgesetz, das im Terrorfall den Abschuss von Passagierflugzeugen erlaubte. "Die Würde des Menschen ist unantastbar", sagt das Deutsche Grundgesetz.

Gesinnungsethik versus Verrechnungsethik

Die philosophische Fassung des Problems ist als Weichensteller-Dilemma bekannt: Eine Straßenbahn ist außer Kontrolle geraten und droht, fünf Personen zu überrollen. Die einzige Handlungsoption eines Zeugen besteht darin, die Bahn auf ein Nebengleis umzuleiten, wo sie nur eine Person überfahren würde.

Eins zu fünf - für Verantwortungsethiker, denen es auf das Ergebnis ankommt, ist die Entscheidung klar. Natürlich werden sie die Weiche umlegen. Für Gesinnungsethiker kommt es auf das Prinzip des Handelns an, und das verbietet, Menschenleben gegeneinander aufzurechnen. Gesinnungsethiker lehnen es ab, wenige Menschen gezielt zu opfern, um viele andere zu retten. Sie legen die Weiche nicht um, sie lassen das Schicksal walten.

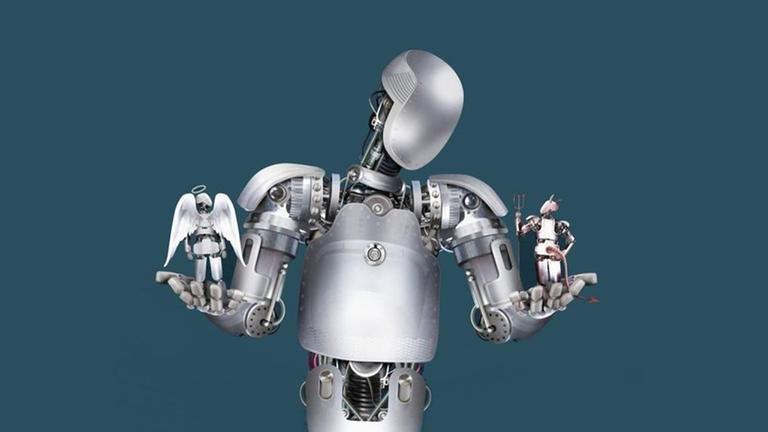

Unverantwortlich? Nur auf den ersten Blick. Denn die Verrechnungsethik würde letztlich ja auch rechtfertigen, einen gesunden Menschen als Organspender zu opfern, wenn so fünf andere am Leben bleiben. Der Mensch wäre zum Rettungsmittel degradiert. Und nicht viel anders ist es, wenn künstliche Intelligenz am Lenkrad sitzt und bei einem Unfall entscheiden muss, wem sie ausweicht. Menschen wägen in einer solchen Situation nicht ab, sondern reagieren im Affekt. Algorithmen sind nicht impulsiv, sie handeln, wie sie programmiert wurden.

Ein doppeltes Dilemma

Wie reagiert der Staat, wenn der technische Fortschritt seine ethischen Grundprinzipien in Frage stellt? Passt er sie den Möglichkeiten der Technik an? Also dem, was sich programmieren lässt.

Klar, man könnte das autonome Fahrzeug auch gesinnungsethisch programmieren, so dass es nicht eingreift, sondern das Schicksal walten lässt: also auf Kurs bleibt, wenn ein Kind dem Ball hinterher vors Auto rennt, oder eben nur ausweicht, wenn dies niemand anderen gefährdet. Will man das wirklich?

Sobald jedoch Entscheidungsszenarien vorgegeben werden, muss man nach bestimmten Kriterien abwägen: Wer hat die besten Überlebenschancen? Soll das Auto der jungen Mutter ausweichen oder dem älteren Herrn? Dem Einzelnen oder der Gruppe? Welche Abwägungskriterien auch immer man zugrunde legt, die Würde des Menschen wird antastbar im Namen des minimierten Unglücks.

Deswegen auf den Wechsel zum selbstfahrenden Auto zu verzichten, wäre allerdings auch keine Lösung. Jedenfalls nicht aus verantwortungsethischer Perspektive. Man würde sich der Möglichkeit berauben, die Anzahl der Unfälle überhaupt erst einmal drastisch zu senken.

Vorfahrt für Bedenken

So stellt nicht nur die Pandemie oder der Terrorismus, sondern auch der technische Fortschritt einen zentralen Wert des Deutschen Grundgesetzes in Frage. Das autonome Fahrzeug, das die Anzahl von Verkehrsopfern minimieren soll, fährt die Gesellschaft in den Modus der Katastrophenmedizin, hin zur ergebnisorientierten Verantwortungsethik.

Wie die Gesellschaft dieses doppelte Dilemma lösen wird, bleibt offen. Dies aber ist gewiss: Will man sich die Moral nicht von der Technik vorgeben lassen, darf man dem Digitalem nicht per se die Vorfahrt vor dem Bedenken geben.