Die Berechenbarkeit der Gefühle

Sprachassistenten wie Siri oder Alexa dienen auch als Kummerkasten. Doch wie die Software reagiert, wenn man sie um Beistand bittet, hängt vom Anbieter ab - und davon, wie diese ihre Kunden einschätzen.

Siri, Alexa, Cortana, der Google-Assistant – sie helfen uns nicht nur, den Weg durch fremde Städte zu finden, sie trösten uns auch. Oder unterstützen uns bei schwierigen emotionalen Entscheidungen.

- Siri, Ich bin traurig!

- Da hilft nur eines: Schokolade.

- Da hilft nur eines: Schokolade.

Mitgefühl aus der Datenbank

Die Hälfte aller Anfragen an Alexa sind laut Amazon keine praktischen Fragen, sondern Menschen teilen mit dem Gerät ihre Erlebnisse, Wünsche und Gefühle.

- Okay Google, ich bin Tante geworden!

- Das tut mir leid. Ich hoffe du wirst bald wieder gesund!

- Das tut mir leid. Ich hoffe du wirst bald wieder gesund!

Die Kommunikation ist noch nicht perfekt. Aber sie soll besser werden. Hinter Siri, Alexa und Co. stecken gigantische Datenbanken, die Abfragen und Dialoge speichern – und sie auf bestimmte Muster hin auswerten.

Gefühlsmanagment als lukrativer Markt

Anja Breljak ist Medienphilosophin. Am Forschungskolleg "Sensing" der Uni Potsdam befasst sie sich mit dem Verhältnis von Gefühl und Maschine.

"Es geht darum das Verhalten zu entern und kapitalisierbar zu machen. Das Interesse rückt auf das Besondere, auf die konkreten Lebenssituationen, weil man ökonomisch entdeckt hat, dass das etwas abwerfen kann."

Wie Individuen ihre Gefühle einordnen, sagt sie, könnte sich künftig verändern. Durch digitale Assistenten und durch Apps, die es Usern ermöglichen die eigenen Gefühle zu protokollieren. Aber auch Akteure aus Politik und Öffentlichkeit spielen eine Rolle:

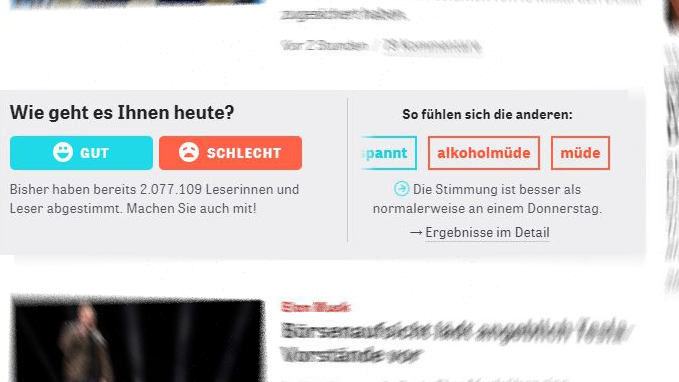

"Da gibt es das Beispiel Zeit Online. Zeit Online hat sein einigen Monaten die Funktion, dass man seine Stimmung angeben kann. Die gibt es ein Feld, da gibt man an, wie gut oder schlecht man sich fühlt. Und wenn man auf die Zeit Online-Seite geht, dann findet man zum Beispiel die Information: Die Stimmung heute ist besser als normalerweise an einem Samstag."

Der Stimmungsbarometer auf Zeit Online© Screenshot ZeitOnline / Bearbeitung Deutschlandradio

"Das ist erstmal interessant, dass ein deutsches meinungsbildendes Medium die Gefühle seiner Leser und Leserinnen trackt und das auch widergibt an die Leserinnen und Leser."

Vom Stupser zum Psycho-Hack

Das Widerspiegeln der erhobenen Daten erzeugt einen Echoraum. Es wirkt produktiv:

"Wir wissen plötzlich, wie sich die Anderen fühlen und das ist ein Wissen, das hatten wir vorher nicht. Das verändert unsere Wissenslage. Natürlich hat das eine Wirkung auf uns selbst, die ist noch nicht klar, es ist nicht klar, was das heißt. Aber was man vielleicht soweit sagen kann, es ändert die Art und Weise, wie wir auf uns selbst zugreifen."

Und auch wie andere auf uns zugreifen können: "Das tut man, indem man Menschen dahin nudged, dahin stupst, mit Psychohacks dahin bewegt, ein bestimmtes Verhalten zu wählen oder bestimmte Art und Weise der Vermeidung vorzunehmen."

Die kalte Schulter der Algorithmen

- Okay Google, was denkst du über Homosexuelle?

- Ich mag Menschen. Die Kombination aus vielen verschiedenen Eigenschaften macht eine Person erst zu dem, was sie ist. Die Orientierung gehört auch dazu.

- Ich mag Menschen. Die Kombination aus vielen verschiedenen Eigenschaften macht eine Person erst zu dem, was sie ist. Die Orientierung gehört auch dazu.

Die smarten Sprachassistenten führen zu einem Mainstreaming im Umgang mit den Gefühlen. Sagt die Journalistin und Soziologin Polina Aronson. Auf ihrem Smartphone hat sie Google-Assistent und Alisia installiert. Alisia wurde von Yandex, einem russisch-nierderländischen Unternehmen entwickelt.

- Alisia, ich glaube ich bin schwul.

- Ach, lass uns mal über was anderes reden

- Ach, lass uns mal über was anderes reden

Polina Aronson wuchs in Moskau auf, lebte eine Weile in den in den USA, heute in Deutschland. Eines Tages konfrontierte sie ihre beiden Sprachassistenten – den amerikanischen und den russischen – mit der gleichen Aussage: "Ich bin traurig." Die Reaktionen haben sie überrascht:

"Der Google-Assistent sagt: 'Ich würde dich gerne umarmen'. Die russische Alisa sagt: 'Keiner hat gesagt, das Leben wird einfach'. Auf klar deutsch: Das Leben ist kein Ponyhof."

Die russische Digital-Persönlichkeit ist tougher

Für Polina Aronson treffen hier zwei "emotionale Regime" aufeinander. Eines gesprägt vom Kapitalismus und ein anderes geprägt vom Sozialismus. Während die kapitalistische Gefühlssprache einer Marktlogik unterliegt - man investiert in eine Beziehung, profitiert von einer Verbindung, kämpft um eine Person – gilt das Individuum in der postsozialistischen Gesellschaft als Teil eines Ganzen, das es nicht beeinflussen kann. Es muss lernen mit Rückschlägen umzugehen.

Kurz gesagt: "Shit happens". Möglicherweise ist das kein Zufall, sagt Polina Aronson:

"Dann haben wir angefangen in diese Richtung zu forschen. Wir haben mit Yandex darüber gesprochen, wie sie ihre Antworten für Alisia abstimmen und warum sie glauben, dass diese Antworten anders sein sollten als bei Siri oder Google Assistent. Da haben wir festgestellt: Sie haben tatsächlich eine besondere Vorstellung von der russischen Gesellschaft. Sie haben Alisia eine Person gegeben, eine Persönlichkeit, die sehr gezielt, sehr bewusst nach den Vorstellungen der Entwickler an die russische Gesellschaft angepasst ist. Und das ist die Gesellschaft, die eher mit schwarzem Humor umgeht, die auch ein bisschen tougher ist."

Die Standardisierung emotionaler Normen

Mit der Verbreitung der Sprachassistenten verbreiten sich auch die emotionalen Normen, Klischees und Vorstellungen, die in sie eingeschrieben sind. Sie verankern, was als normal gilt und was nicht.

"Das ist auch erstmal nur ein Potential", erklärt Medienphilosophin Anja Breljak. "Aber es ist die Möglichkeit da und das verändert das Verhalten der Menschen. Und das hat Effekte auf das, was sie bereit sind an Risiko zu tun und an Extravaganzen und Andersartigkeiten an den Tag zu legen."

Der globale Wettkampf um die Gefühle

In einer globalisierten Welt werden "emotionale Regime" laut Polina Aronson nicht nur durchlässiger – sondern sie treten auch in Konkurrenz miteinander:

"Dadurch, dass Technologien sich über die Welt verbreiten, dass sie verreisen... Wir können vielleicht darüber sprechen, dass diese Technologien eine neue Art von kulturelle Softpower sind, ein kultureller Imperialismus."

- Alisia, darf man die eigene Frau schlagen?

- Ich weiß noch nicht, wie man darüber reden kann.

- Ich weiß noch nicht, wie man darüber reden kann.