Wir dokumentieren die Sendung an dieser Stelle gekürzt. Das vollständige Manuskript des Features können Sie HIER herunterladen.

Filtern als Kulturtechnik

28:28 Minuten

Seit über Filterblasen diskutiert wird, ist die Kulturtechnik des Filterns in Verruf geraten. Dabei ist Filtern - vom Ohrstöpsel bis zum Schornstein - meist eine nützliche Sache, ohne die wir nicht überleben würden. Und unser Gehirn braucht das Filtern auch.

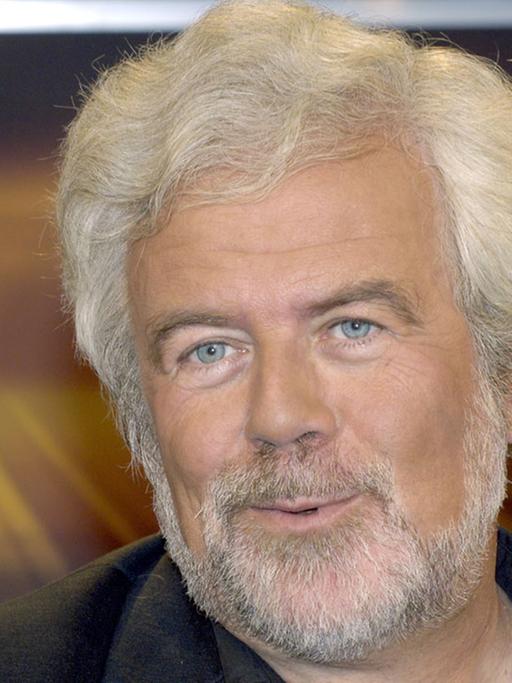

Kaffee wird gefiltert.

Leitungswasser wird in Klärwerkanlagen durch spezielle Filter von Schadstoffen bereinigt.

Filterzigaretten.

Spamfilter schützen vor bösartigen Viren und Informationsverschmutzung.

Musik wird gefiltert.

Auch diese Sendung ist gefiltert. Die O-Töne wurden von "ähs" und "ähms" bereinigt.

Was wäre eigentlich, wenn es keine Filter mehr gäbe? Alle Filter abgeschaltet und Filterblasen aufgelöst würden? Wäre das ein erstrebenswerter Zustand? Oder brauchen wir Filter?

Angeblich steckt jeder von uns in einer Filterblase

Eine Filterblase oder Filter Bubble ist die selektive Informationsauswahl auf Webseiten durch Berücksichtigung des Nutzerverhaltens.

Der Begriff Filterblase geht auf den Aktivisten Eli Pariser zurück.

2011 beschreibt Pariser in seinem Buch "Filterbubble", dass das Internet seine Nutzer nur noch mit Meinungen konfrontiere, die deren eigene Überzeugungen verstärkten. Die Filterblasen-Theorie.

"Sie beschreibt quasi einen algorithmisch kuratierten Informationskosmos auf Plattformen wie Facebook, der dem Einzelnen, so zumindest die Theorie, bereits bestehende Meinung zurückspiegelt, seine Position in einem beständigen Feedbackloop bestätigt und widersprechende Sichtweisen und kognitive Dissonanzen weitestgehend ignoriert", sagt Felix Maschewski, Literaturwissenschaftler und Essayist.

Filter 2: Die Jalousie© imago / fStopimages

Herausgefiltert wird, was das eigene Selbstbild stören könnte.

Allerdings nicht zwangsläufig durch technische Ursachen in Form einer algorithmischen Kuration, sondern auch durch die Art und Weise, wie der Mensch die Welt online und offline wahrnimmt.

Der Journalist David Roberts spricht von einer tribalen Epistemologie, die sich im Internet beobachten lässt. Eine Information werde nicht anhand von Kriterien wie wissenschaftlichen Standards der Beweisführung oder gar der Anschlussfähigkeit an das allgemeine Weltverständnis beurteilt, sondern einzig und allein danach, ob sie den Werten und Zielen des Stammes entspräche.

Das bestätigt auch der Kulturwissenschaftler Michael Seemann in seiner 2017 veröffentlichten Studie "Digitaler Tribalismus und Fake News". "Digitaler Tribalismus" bilde den Kern des Erfolgs von Bewegungen wie Pegida und AfD, wie auch der Alt-Right und anderen antiliberalen Kräften.

In der rechten Parallelwelt

Wie diese digitale Stammesbildung aussieht, hat der Kurator Alain Bieber im Internet beobachtet.

"Wir haben jetzt gerade eine Ausstellung konzipiert, die heißt "im Zweifel für den Zweifel. Verschwörungstheorien Fake News, alternative Fakten"; Wir haben natürlich angefangen zu recherchieren, und wenn man sich mit solchen Themen beschäftigt, dachte ich, mache ich mir auch mal so einen Fake-Account."

Mit diesem Account ist der Kurator Alain Bieber in eine rechte Parallelwelt abgetaucht:

"Wir sehen ein blondes Mädchen auf der Schaukel, wahrscheinlich blonde Arierin mit Rosenkranz auf dem Kopf, am Schaukeln, schaut ein bisschen traurig. Und dann die Unterschrift: Warum macht Merkel Deutschland kaputt? Das da fand ich auch sehr abgefahren: die arischen Siedler. Das ist auch so ein ganz beliebtes Thema in diesen Szenen. Das schlimmste sind immer diese Kommentare, was die Leute dann noch so mitkommentieren. Seufz, lang lang ist es her. Und das hat was von irgendwie so Wikinger-Ambiente, Sehnsucht. Ich und meine arische Familie damals, keine Ahnung. Und dann immer so absurdes Zeugs."

Solche recht harschen politischen Kommentare werden mit Katzenbildern und irgendwelchen Papageien zwischengeschaltet.

"Das sind einfach Leute, die auch immer mal ein Katzenbild posten. Das ist so eine Mischung aus Knuddeln..."

... und Hass.

"Wenn man sich durch so einen Newsfeed mal scrollt, fällt einem auf seriöse, normale Medien gibt's da gar nicht mehr. Die kommen gar nicht mehr vor."

Man nimmt wahr, was der eigenen Meinung entspricht

Der Rechtswissenschaftler Dan M. Kahan untersuchte in zwei 2017 veröffentlichten Studien wie beispielsweise politische Überzeugungen die Wahrnehmung von Argumenten und Fakten beeinflussen. Seine Schlussfolgerungen wirken ernüchternd:

Menschen seien in erster Linie daran interessiert, ihrer eigenen Identität gerecht zu werden, anstatt ein objektives Weltbild zu kultivieren.

Kahan spricht von der sogenannten "identitätsschützende[n] Kognition".

"Ich suche mir die Leute aus, mit denen ich unterwegs bin, die ja eine bestimmte politische Meinung vertreten, die bestimmte Infos durchsickern lassen oder auch nicht, Themen worüber man redet oder auch nicht. Und genau deswegen glaube ich auch, dass ich, wenn ich mich im Internet bewege, ja auch ähnlich verhalte. Diese Wahrnehmung hat ja auch eine Geschichte, sie entwickelt sich im Laufe der Zeit und entsteht zu einem Filter."

Filter 3: Der Kaffeefilter© imago / Steinach

Der Philosoph Immanuel Kant vertrat die Sichtweise, dass Menschen die Welt durch einen Filter wahrnehmen.

In "Kritik der reinen Vernunft" argumentiert der Erkenntnistheoretiker, es sei unmöglich, die Dinge so wahrzunehmen, wie sie wirklich sind.

"Wir sehen die Welt ja nicht, wie sie wirklich ist, sondern wir sehen sie immer nur subjektiv durch uns, mit all dem, was wir mitbringen", sagt Oliver Ruf. Er lehrt Medien- und Gestaltungswissenschaft, unter anderen mit den Schwerpunkten Medienästhetik und Kommunikationstheorie.

"Und deswegen können wir das eigentlich gar nicht, das Ding an sich, niemals wirklich die Objektivität erreichen, sondern immer nur in einer bestimmten Art und Weise der Auslegung, wie wir gerade mit etwas umgehen und was uns zur Verfügung steht."

Wie das Gehirn Informationen filtert

Erziehung und Erfahrung, die Umgebung, in der man aufgewachsen ist, Erwartungen und Emotionen wirken wie Filter.

Sie haben einen starken Einfluss auf die Wahrnehmung der Welt, die immer selektiv ist.

Filter 4: Ohrstöpsel© picture alliance / dpa - Emily Wabitsch

Aber wie funktioniert das genau? Wie filtert unser Gehirn das, was es verarbeitet?

"Wir haben im Gehirn im höchsten Zentrum, dem Neokortex, sogenannte primäre Projektionsareale. Da läuft, kann man sagen, die sensorische Information wirklich auf kortikaler Ebene ein. Und dann haben wir andere Regionen, die damit betraut sind, solche Intentionen, Handlungsziele, die wir verfolgen, zu repräsentieren", sagt Birgit Stürmer, Professorin für Allgemeine Psychologie und Neurokognitive Psychologie.

Zum Beispiel der Präfrontalkortex: "So, und das ist Top-down-Verarbeitung. Da sind Intentionen repräsentiert in großen Netzwerken. Und die Bottom-up-Informationsverarbeitung ist auf kortikaler Ebene dann eben zunächst in diesen primären Projektionsarealen."

Es wird also unterschieden zwischen einer Selektion, die sensorisch funktioniert – welcher Reiz ist sensorisch auffällig? – und der Topdown-Regulation: Welche Information passt zu meinen Intentionen und Handlungszielen?

"In der Aufmerksamkeitsforschung hat das eine zentrale Rolle gespielt, dass Broadbent sich gefragt hat, wenn wir beispielsweise mit zwei Nachrichten konfrontiert sind, eine auf dem linken Ohr und eine auf dem rechten Ohr, wieso können wir eine Nachricht verarbeiten und die andere nehmen wir überhaupt nicht wahr, die blenden wir komplett aus, und seine Theorie ist in die Literatur eingegangen als die Filter-Theorie", sagt die Psychologin Hilde Haider.

Der Psychologe Donald Eric Broadbent spielte seinen Probanden auf dem linken und rechten Ohr zwei unterschiedliche Nachrichten vor. Die Probanden hatten die Aufgabe, sich auf den Inhalt einer Nachricht zu konzentrieren.

Filter 5: Das Küchensieb© imago / Blickwinkel

Broadbent fand heraus, dass die Teilnehmer nur den Inhalt der priorisierten Nachricht wiedergeben konnten. Er ging somit davon aus, dass eintreffende Informationen zunächst selektiert werden. Ihr Inhalt werde erst im Anschluss erfasst.

Hilde Haider: "In dem Moment, wo ich eine Nachricht priorisiere, habe ich keine Kapazität mehr. Das ist so ein sogenanntes strukturelles Bottleneck oder Flaschenhals, dass wir einfach nur eine Information zu einem Zeitpunkt wirklich bewusst verarbeiten können und die andere Information wird sozusagen aus dem System rausgehalten, um das System, so seine Auffassung, vor Überlastung zu schützen."

Dieses Modell ist allerdings unzureichend.

"Diese Annahmen von Broadbent haben sich relativ schnell als zu kurz gegriffen herausgestellt, weil, das kennt ja jeder, wenn wir auf einer Cocktailparty oder auf einem großen Fest sind, dann ist es ja so, dass wir sehr fokussiert auf unsere Gesprächspartner sein können. Aber wenn beispielsweise irgendjemand unseren Namen ausspricht, reagieren wir sofort und können die Aufmerksamkeit auf diese Personen richten oder von der eigentlichen Informationsquelle wegrichten."

Filtern zu können, ist überlebenswichtig

Es ist also genau anders rum. Die Inhalte eintreffender Nachrichten werden sofort erfasst und augenblicklich nach ihrer Bedeutung selektiert.

"Das war ein sehr großer Meilenstein, dass sie klar gemacht haben, das ist nicht ein Defizit, dass wir zu wenig Kapazität haben, sondern es ist eigentlich die notwendige Voraussetzung dafür, dass wir zielgerichtet handeln können. Wenn man sich schlicht und ergreifend einen Frosch vorstellt, der mit gleicher Intensität nicht eine Fliege, sondern zehn Fliegen sehen würde. Der hätte keine Grundlage mehr, sich für eine Fliege zu entscheiden, der würde einfach verhungern. Das heißt, der Organismus braucht diese Fixierung auf einen Gegenstand, mit dem dann gehandelt wird. Das heißt, diese Filterung ist essenziell, damit wir überhaupt handeln können. Genau, das ist die Selektivität der Wahrnehmung. Oder andersherum ausgedrückt eben der Effekt des Filterns."

Filter 6: Die Atemschutzmaske© imago / Seeliger

Filtern ist also überlebenswichtig.

Eingehende Nachrichten, Sinneseindrücke, Bedürfnisse und Emotionen müssen selektiert werden, um Entscheidungen treffen zu können, Situationen einschätzen zu können. Um Wichtiges von Unwichtigem zu trennen:

"Es geht darum, Prioritäten zu setzen. Wenn ich eine Priorität habe, wenn ich ein bestimmtes Handlungsziel habe, dann sehe ich primär die Informationen, die ich sehen will, beziehungsweise, die ich brauche, um die Handlung ausführen zu können", sagt Hilde Haider.

Was tun mit der Masse an Informationen im Internet?

Pro Sekunde werden weltweit 6000 Tweets gepostet. Insgesamt sind es 500 Millionen Tweets pro Tag. 2021 werden über 300 Milliarden E-Mails verschickt werden. Hilde Haider:

"Unsere Welt ist hochkomplex in der Informationshaltigkeit, dann kann ich nichts anderes tun, als zu reduzieren, als Informationen sozusagen auszublenden."

Filter 7: Der Zigarettenfilter© imago / Reporters

Wie viele Informationen müssen aber überhaupt verarbeitet werden, um sich eine sinnvolle Meinung über einen Sachverhalt bilden zu können?

Professor Georg Weizsäcker lehrt Verhaltensökonomie an der Humboldt Uni in Berlin. Die volkswirtschaftliche Entscheidungstheorie geht davon aus, dass wir Informationen sammeln müssen, um bessere Entscheidungen zu treffen. Allerdings beobachtet er, "dass wir auf relativ wenig Information relativ stark reagieren. Und dass wir auf relativ viel Information relativ schwach reagieren. Also um ein Beispiel zu sagen: wenn Sie eine Meinungsumfrage unter drei Freunden machen und die sagen alle drei das gleiche, dann sind Sie sich ziemlich sicher, dass die Aussage auch stimmt. Wenn Sie eine Meinungsumfrage unter dreißig Freunden machen und von denen sagen 25 das gleiche und fünf was anderes, dann ist das Verhältnis immer noch fünf zu eins, und es ist eine starke Aussage, die von diesen dreißig Personen gefällt wird. Aber man neigt dazu, diesen großen Zahlen nicht so zu glauben, sondern zu sagen: naja, gemischtes Bild, eine Mehrheit für die erste Meinung."

Je mehr wir filtern, je weniger verschiedene Meinungen es gibt, desto sicherer werden wir uns. Allerdings ist es möglich, dass das dadurch entstandene Verständnis eines Sachverhaltes fehlerhaft ist:

"Das kann gut sein, dass wir durch die Beschränkung der Menge der Information, die bei uns täglich ankommt, unser Leben insofern leichter und erfolgreicher gestalten, dass wir zum Beispiel unsere Konsumentscheidungen oder Wahlentscheidungen leichter fällen können. Und leichter heißt hier: unter geringeren Kosten. Aber sie können natürlich eben falsch sein."

Uns fällt also leichter mit weniger Informationen umzugehen, auch wenn wir damit das Risiko eingehen, eventuell fehlerhafte Entscheidungen zu treffen.

"Wenn man sich menschliche Sprache anschaut: Das, was wir tun, ist ja letztendlich, wir kategorisieren. Das hier ist ein Glas, egal ob das jetzt ein Senfglas ist oder ein Weinglas ist. Es ist ein Glas. Ich habe ein Wort, um eine ganze Klasse von Objekten damit zu bezeichnen. Warum tue ich das? Es reduziert die Komplexität der Welt.

Stimmt die Filterblasen-Theorie überhaupt?

Im Internet helfen Suchmaschinen die Komplexität der digitalen Welt zu reduzieren.

Allerdings scheint hier die Filterblasen-Theorie nicht vollkommen aufzugehen.

Die Organisation Algorithm Watch fand im Rahmen der Aktion Datenspende heraus, dass Suchergebnisse zu bekannten Politikern von Nutzer zu Nutzer sich nicht maßgeblich unterschieden.

Zu ähnlichen Ergebnissen gelangten auch die Soziologen Mario Haim, Andreas Graefe und Hans-Bernd Brosius in einer Auswertung der Nachrichtenplattform Google News. Auch hier lieferten die Ergebnisse keine Unterstützung der Filterblasenhypothese.

Filter 8: Der UV-Filter© picture alliance / ZB / Arno Burgi

Also doch keine Filterblase?

"Ich glaube, wenn wir es kulturphilosophisch betrachten, kann man den Begriff der Schwelle vielleicht zunächst einmal betrachten, also im Sinne auch von Benjamin beziehungsweise auch, wenn wir jetzt eine Kulturtheorie noch heranziehen von Bataille, dass es eine Art von Überschreitung ist. Also dass etwas zwischen uns sich befindet, dass wir erlangen wollen", sagt Oliver Ruf.

Eine Überschreitung in den virtuellen Raum des Smartphones, der für uns Informationen filtert.

"Wie finde ich einen Ort, also wie komme ich irgendwo hin? Früher hat man erst mal sehr umständlich eine Karte entfaltet und dort geschaut, wo ist man überhaupt? Das ist das Mapping. Und heute nehmen wir das Smartphone in die Hand, das sofort erkennt, wo wir uns befinden. Wir geben einen anderen Ort ein und wir gehen einen Weg und nehmen gar nicht mehr wahr in welchem System von Straßen wir uns befinden, sondern wir schauen nur noch auf diesen Bildschirm, der uns gewissermaßen gefiltert leitet, wo wir hingelangen und das ist eigentlich dieser Moment. Das ist eine Art von Schwelle, die wir dann überschreiten. Und deswegen, glaube ich, ist diese Art von Schwelle, die man überschreitet, ist eben auch eine Art von Filter, den man sich vor seine eigene Wahrnehmung setzt, um eine bestimmte Art von Welt neu zu erfahren."

Sie nicht nur neu zu erfahren, sondern sie auch buchstäblich neu zu inszenieren.

Etwa durch Apps wie Instagram:

"Gerade das Filtern ist für Instagram, hat gewissermaßen eine neue Popularität erlangt. Und warum tut man das? Es ist die Möglichkeit, die Wahrnehmung zu steuern. Man zeigt genau dorthin, was man sehen möchte oder was man gesehen haben möchte. Dieses Filtern ist eine Art von Auslegung, die man steuern möchte. Es ist quasi ein Steuerungsmoment in der Auslegung, und dann wird gewissermaßen diese Applikation zu einer Art von Bühne, wie in jedem Theaterstück. Eine Bühne ist dazu da, etwas zu inszenieren. Man inszeniert sich selbst und man möchte sich in einer gewissen Art und Weise zeigen und gesehen werden. Und dazu nutzt man eben etwas, was dazwischengeschaltet ist."

Filter 9: Der Effektfilter beim Fotografieren© imago / Viennaslide

Filter geben dem digitalen Bild die verlorene Aura des Analogen wieder zurück.

Nostalgiefilter

Erinnerungsfilter

"In der Fotografie gab es das eigentlich fast schon immer, seitdem es Objektive gab, gab es Filter, die auch davor geschaltet werden können, um dieses Spiegelbild auch in einer gewissen Art und Weise mit einer Atmosphäre zu belegen, mit einer Art und Weise das neu wahrzunehmen", sagt Oliver Ruf.

Etwa das Claude Glas, ein Spiegel, der im 18. Jahrhundert zur Landschaftsbetrachtung eingesetzt wurde. Das Glas tauchte Landschaften in neue Koloraturen, die auch Eingang in die Malerei dieser Zeit fanden.

Digitale Schlammschlacht im Netz

Ein Blick auf einen kontroversen Tweet des rechten Gesellschaftskritikers Don Alphonso.

Es kommentieren nicht nur Befürworter, sondern auch Kritiker. In den Gesprächsfäden tobt eine digitale Schlammschlacht. Unterschiedliche Meinungen treffen aufeinander.

Allerdings scheinen diese inhaltlichen Dissonanzen keinen Einfluss auf die Meinungen der sich duellierenden Kontrahenten zu haben. Im Gegenteil: die gegnerischen Positionen erfahren eine Verfestigung.

Das sagt eine Studie vom März 2018. Ein Team um den US-Soziologen Christopher Ball von der Duke University hat in einem Experiment Demokraten und Republikanern auf Twitter mit gegenläufigen Meinungen konfrontiert. Das führte bei den Demokraten zu einer leichten Intensivierung ihrer liberalen Einstellung, die politische Agenda der Republikaner erfuhr eine massive Verstärkung.

Filterclash statt Filterbubble?

Felix Maschewski: "Ich muss gar nicht nur in die Kommentarspalten von Don Alphonso schauen, sondern einfach nur das Hochzeitsfoto auf meiner Timeline vom Freund, dann die Nachricht meinetwegen der Flut von Mallorca sehen. Das bringt mich die ganze Zeit in diesen Spannungszustand, wo ich definitiv sagen kann, das sind Dinge, die ich irgendwie nicht unbedingt miteinander vereinbaren kann."

Der Medienwissenschaftler Bernhard Pörksen spricht von der "unerträglichen Gleichzeitigkeit des Seins", dem "Schock des Unvereinbaren", der zu einem wesentlichen Bestandteil des Internets geworden sei.

Filter 10: Die Filterblase© Marc Sendra Martorell / Unsplash

Bereits die Infrastruktur des Netzes widerspricht der Vorstellung einer Filterblase, da man sich über Verlinkungen durch das Internet bewegt.

Jeder Klick kann neue Welten und Perspektiven eröffnen.

"Ich glaube, dass wir uns ein stückweit und das ist gerade die Problematik auch gerade von so einer Metapher wie der Filterblase, dass wir diese Erzählung ein stückweit anders hinterfragen sollten, weil dieses Prinzip der Verlinkung, was Bernhard Pörksen da anspricht, dass es also auf diese verstörende Gleichzeitigkeit des Disparaten, die Erfahrung von Kontingenz und Komplexität oder auch, er spricht von kollabierenden Kontexten und solchen Dingen, das ist auch eine Erfahrung des Internets", sagt Felix Maschewski.

Es fehlt an einer digitalen Diskursethik

Die Diskussion um die Filterblase, die angeblich die Demokratie bedrohe, scheint ein viel gravierenderes Problem zu verdecken.

Das Fehlen einer digitalen Diskursethik.

Felix Maschewski: "Ich glaube, dass die Fokussierung auf den Begriff oder die Metapher der Filterblase mit einer Enttäuschung einhergeht, dass wir nach der Einsicht, dass es auch andere Blasen gibt und dass wir auch in diese Blasen hineingeschaut haben, dass wir nach diesem großen Gespräch, das wir auch mit anderen Menschen geführt haben, vielleicht erkannt haben, dass wir den Anderen nicht nur nicht besser verstehen, sondern vielleicht ihn auch weniger mögen. Und dass wir plötzlich etwas sehen, was uns vorher ein Stück weit, weil wir diese Medien noch nicht hatten, verborgen geblieben ist. Er hat etwas sichtbar gemacht und damit auch etwas unbestreitbar, dass wir damit noch wirklich unerfahren sind."

"Dass man sich überhaupt darüber im Klaren sein muss, dass mit diesem Medienwandel, der stattgefunden hat, wir alle zu Sendern geworden sind", sagt Felix Maschewski. "Wie geht man damit um, dass andere Menschen andere Meinungen haben? Und was heißt Verständnis? Was heißt Konsens? Wie lässt sich das unterscheiden?"

Wir sind nicht mehr nur passive "Empfänger", dass damit aber auch eine gewisse Verantwortung einhergeht.

Und wie soll dieser Verantwortung im Sinne einer digitalen Diskursethik begegnet werden?

Vielleicht hilft der Philosoph Sokrates weiter.

In seinem Drei-Siebe-Modell beschreibt er eine ethische Informationsfiltertechnik.

Medial vermittelte Informationen müssen, bevor sie verteilt werden, durch drei Siebe gehen.

Das Sieb der Wahrheit: Ist die Nachricht wahr, die weitergegeben wird?

Das Sieb des Guten: Ist es etwas Gutes, das erzählt wird?

Das Sieb der Notwendigkeit: Ist es wirklich notwendig, dass diese Nachricht erzählt wird?

Um unsere eigenen Beiträge im Internet zu überdenken, wäre eine Beherzigung dieser drei Filter sicherlich sinnvoll.

Vielleicht ein erster Schritt für die Entwicklung einer neuen digitalen Diskursethik?

"Ich glaube, mit dieser Diskursethik, die wir erlernen müssen, würde auch eine Medienreflexionskompetenz einhergehen", sagt Felix Maschewski. "Das wäre so etwas, dass wir wirklich lernen, auch diese gesamten Technologien ein Stück weit anders zu lesen, dass wir lernen, vielleicht über die Folgewirkung positive Potenziale durchaus aber auch negative Konsequenzen stückweit anders nachdenken lernen. Das wäre begrüßenswert."