Roberto Simanowski ist Kultur- und Medienwissenschaftler und lebt nach Professuren an der Brown University in Providence, der Universität Basel und der City University of Hong Kong als Medienberater und Buchautor in Berlin und Rio de Janeiro. Zu seinen Veröffentlichungen zum Digitalisierungsprozess gehören "Facebook-Gesellschaft" (Matthes & Seitz 2016) und "The Death Algorithm and Other Digital Dilemmas" (MIT Press 2018).

Es droht eine Tyrannei der Mehrheit

04:33 Minuten

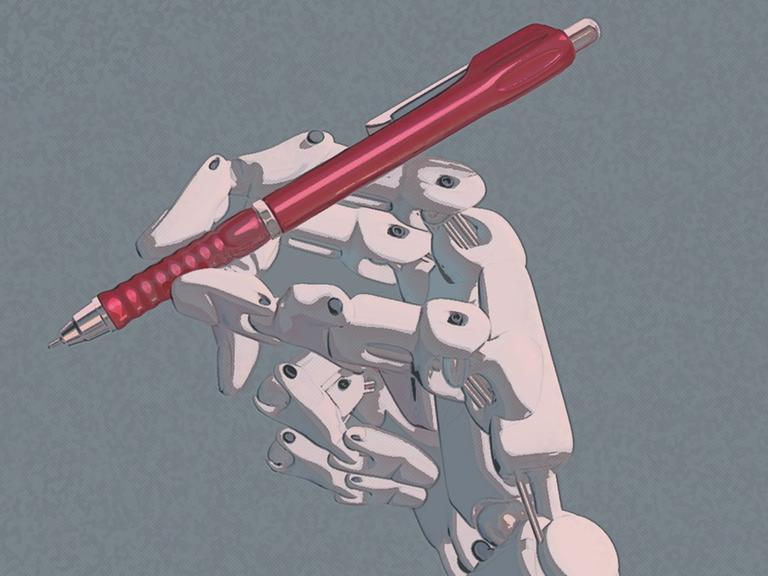

KI kann mittlerweile reden, Texte schreiben und übersetzen. Der Medienphilosoph Roberto Simanowski fragt sich, wer da überhaupt spricht? Und was wird aus Minderheitspositionen, wenn eine Maschine agiert, die der Mehrheitsmeinung folgt?

Im letzten Jahr erregte ein Artikel im Guardian Aufsehen, der die Gefahr der künstlichen Intelligenz für die Menschen diskutierte. Aufsehenerregend war nicht die Entwarnung, sondern dass die künstliche Intelligenz selbst den Artikel geschrieben hatte. Natürlich fragt sich der skeptische Mensch da, ob die KI wirklich so über unser beider Verhältnis in der Zukunft denkt – und ob sie uns warnen würde, wenn es anders wäre.

Künstliche Intelligenz ist opportunistisch

Wer mehr von KI versteht, weiß, dass sie uns nur gesagt hat, was wir, die Menschen, selbst über unser Verhältnis zu ihr denken. Denn die KI denkt gar nicht, wenn sie spricht, sie rechnet. Als künstliches neuronales Netzwerk verarbeitet sie Information rein statistisch. Sie weiß aus vielen Gigabytes an Text, welches Wort am häufigsten nach einem anderen erscheint, so wie Googles Übersetzungsalgorithmus weiß, welches deutsche Wort am häufigsten für ein englisches benutzt wird. Sie ist eine Opportunistin der Wahrscheinlichkeit, die jeweils das sagt, was die Mehrheit auf ihrer Seite hat. Genau darin liegt identitätspolitisch das Problem.

Rückkehr der Gatekeeper

Ist die künstliche Intelligenz weiblich – über ihr grammatisches Geschlecht hinaus? Oder ist sie männlich, weiß und hetero, weil diese Gruppe den größten linguistischen Fußabdruck im Netz hinterlässt? Genau dies befürchten viele KI-Forscher:innen und sie fordern deswegen, das Daten-Set, an dem die KI das Denken – oder eben Rechnen – lernt, so zu kuratieren, dass darin auch Minderheiten gerecht repräsentiert sind.

Das führt natürlich zur Frage, wer mit welchem Mandat an welchen Schrauben dreht. Korrigieren die Software-Ingenieur:innen im Silicon Valley das Daten-Set nach Gutdünken? Gibt es internationale Aufsichtsgremien? Nach welchen Kriterien entscheiden diese?

Mit dem Versuch, das Daten-Set der KI zu kuratieren, kommt das Politische in die Statistik. Und das ist problematisch selbst diesseits der Identitätspolitik. Denn unabhängig davon, wie die Kuratierung konkret organisiert wird: Sie bedeutet die Rückkehr der Gatekeeper, deren Entmachtung durch das Internet zuvor so enthusiastisch begrüßt wurde. Auch Technikgeschichte ist voller Ironie.

Tyrannei der Mehrheit

Identitätspoltisch gesehen ist die Sache freilich ziemlich ernst. In der On- und Offline-Welt lässt sich die ungerechte Repräsentation ebenso wie ihre Korrektur gesellschaftlich thematisieren. Die Diskussion darüber, wer für was sprechen kann, und wer Amanda Gorman übersetzen darf, ist öffentlich. Das Trainingsset der KI aber entzieht sich der gesellschaftlichen Aufmerksamkeit. Niemand weiß am Ende, wer eigentlich spricht, wenn die KI sagt, der Mensch habe nichts von ihr zu befürchten.

Damit nicht genug. Künstliche Intelligenz ist selbst dann ungerecht, wenn das Daten-Set alle Teile der Gesellschaft und der Welt adäquat repräsentiert. Denn wenn sie tatsächlich streng nach dem Wahrscheinlichkeitsprinzip operiert und sich immer für die Position der Mehrheit entscheidet, verstummt jede Minderheit, egal wie sehr sie vorher gefördert wurde.

Eine solche KI ist das Sprachrohr nicht des Ausgleichs und der Inklusion, sondern des Mainstreams. Also wieder weiß und männlich? Das kommt darauf an, welche Perspektive nach dem Eingriff ins Daten-set am meisten vertreten ist. Aber wer immer es ist, es ist die "Tyrannei der Mehrheit", vor der John Stuart Mill einst warnte und gegen die nun die Identitätspolitik Sturm läuft.

Eine solche KI ist das Sprachrohr nicht des Ausgleichs und der Inklusion, sondern des Mainstreams. Also wieder weiß und männlich? Das kommt darauf an, welche Perspektive nach dem Eingriff ins Daten-set am meisten vertreten ist. Aber wer immer es ist, es ist die "Tyrannei der Mehrheit", vor der John Stuart Mill einst warnte und gegen die nun die Identitätspolitik Sturm läuft.

Das Wahrscheinlichkeitsprinzip folgt dem Modell "The-winner-takes-it-all" und das ist schlimmer als der Schmelztiegel, in welchem die Minderheiten zwar ihre spezifische Individualität verlieren, aber nicht ihren Effekt fürs Ganze. Diese Aussicht zeigt: Technischer Fortschritt ist nicht automatisch auch ein gesellschaftlicher. Und es wird klar, dass einerseits Amanda Gorman nicht von einer KI übersetzt werden sollte und andererseits der Mensch viel mehr von dieser zu fürchten hat, als sie denkt.