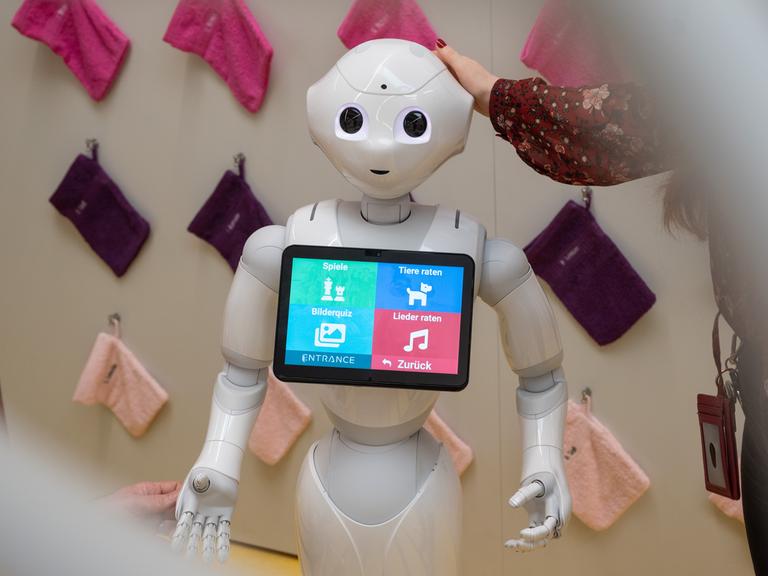

Wenn sich Waffen ihre Ziele selber suchen und zerstören und töten, ohne dass noch ein Mensch eingeschaltet ist, dann hat das erhebliche Konsequenzen. Zwar handeln auch autonome Waffen letztlich so, wie sie von Menschen programmiert worden sind. Aber im Falle eines Einsatzes ist kein Mensch mehr zwischengeschaltet, der auf einen Knopf drückt oder ferngesteuert mit dem Joystick die zerstörerische Wirkung auslöst.

Noch gehören Killerroboter ins Reich von Science-Fiction. Aber beispielsweise ist die Entwicklung sogenannter "intelligenter" Drohnen von mehreren Ländern schon weit vorangetrieben worden. Die Befürworter solcher Technologien argumentieren, dass sich mit ihrer Hilfe in der Kriegssituation der Tod mancher Menschen verhindern ließe – der der jeweils eigenen Soldaten. Aber es könnten auch zivile Personen, die heute unbeabsichtigt getötet oder verletzt werden, besser geschützt werden.

KI kennt keinen Hass, keinen Stress, keine Angst

Algorithmische Systeme werden schon jetzt in vielen militärischen Zusammenhängen verwendet – etwa in den Bereichen Logistik und Aufklärung. Ginge die Entwicklung jedoch weiter in Richtung Autonomie – also in von Menschen nicht mehr ausgelöste und kontrollierte Kampfeinsätze – dann könnte das erhebliche Folgen für die Art der Kriegsführung haben.

Manche sprechen von einer militärischen Revolutionierung, nur vergleichbar mit der Erfindung des Schießpulvers und der nuklearen Sprengköpfe.

Maschinen handeln nicht aus Hass. Sie kennen keinen Stress, keine Angst, keine Müdigkeit. Autonome Waffen vergewaltigen nicht, plündern nicht. Sie kennen aber auch keine Empathie, kein Zögern. Viele sehen es grundsätzlich als ein gegen das Völkerrecht verstoßendes Verbrechen an, wenn künftig Roboter über Leben und Tod entscheiden würden. Das zudem die Würde des Menschen verletzt.

Autonome Waffen verbieten

Seit 2014 wird auf der Ebene der Vereinten Nationen über autonome Waffensysteme diskutiert. Nicht alle Staaten sind sich in der Ablehnung einig. Bisher hat auch Deutschland eine eher abwartende Haltung vertreten. Allerdings hat sich die aktuelle Bundesregierung mit ihrem Koalitionsvertrag verpflichtet, sich für eine völkerrechtsverbindliche Regulierung solcher Waffen internationale einzusetzen.

Welche ethischen, sicherheitspolitischen und juristischen Fragen stellen sich, wenn "Killerroboter" real würden? Lässt sich die Entwicklung noch aufhalten? Besteht die Gefahr, dass mit der Evolution dieser neuen Technologie ein neues Wettrüsten droht?

Darüber diskutieren:

- Silja Vöneky, (Co-)Direktorin des Instituts für Öffentliches Recht, Völkerrecht und Rechtsvergleichung, Universität Freiburg

- Thomas Küchenmeister von der internationalen Kampagne gegen Killerroboter (*)

- Christian Mölling, Forschungsdirektor bei der Deutschen Gesellschaft für Auswärtige Politik und Leiter des DGAP- Programms Sicherheit und Verteidigung

- Frank Sauer, Institut für Politikwissenschaft an der Universität der Bundeswehr, München.

Die Sendung ist in Kooperation mit der

Volkswagenstiftung bei einer Veranstaltung im Schloss Herrenhausen aufgezeichnet worden.

(*) Redaktioneller Hinweis: Wir haben die Berufsbezeichnung korrigiert: