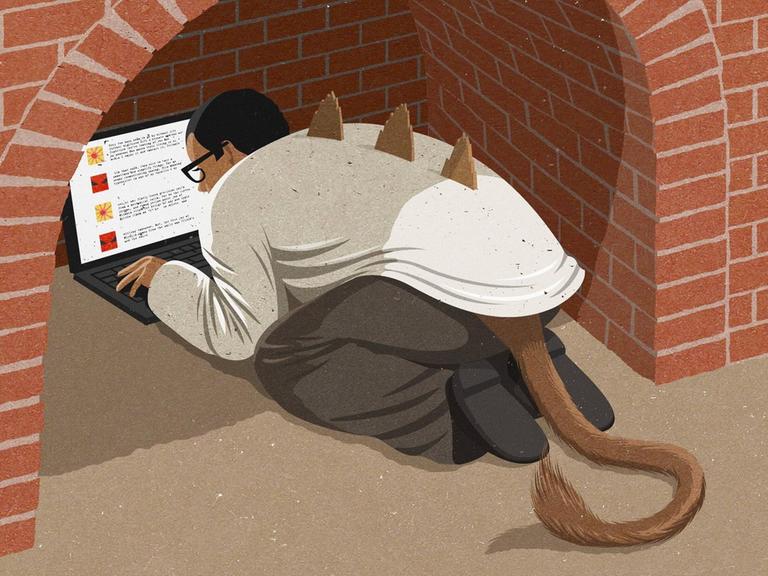

"Rabbit-Hole-Effekt"

Im Netz beeinflussen Algorithmen das Nutzungsverhalten. Ob sie allerdings auch für die Radikalisierung einzelner Surfer verantwortlich sind, ist die Frage. © picture alliance / dpa / Lp / Philippe De Poulpiquet

Algorithmen als Sündenböcke

10:51 Minuten

Wie radikalisieren sich junge Menschen im Internet? Oft wird der "Rabbit-Hole-Effekt" als Grund genannt: Demnach empfehlen Algorithmen Nutzern angeblich immer extremere Inhalte. Der Kommunikationswissenschafltler Jonas Kaiser hat Zweifel daran.

Drohen Menschen, die viel im Internet unterwegs sind, sich in immer extremeren Nischen zu verlieren, ähnlich wie die Hauptfigur von "Alice im Wunderland", die in den Tiefen eines Kaninchenbaus in eine skurrile Fantasiewelt gerät? In Debatten über Gewalttaten aus mutmaßlich rechtsextremen Motiven wie dem Attentat von Buffalo wird oft der sogenannte "Rabbit-Hole-Effekt" als möglicher Grund für eine Radikalisierung angeführt.

Großen Internet-Anbietern wie Youtube wird seit Langem vorgeworfen, dass ihre Algorithmen immer radikalere Inhalte empfehlen, um Nutzer möglichst lange auf der Plattform zu halten. Auf diese Weise trügen sie auch zu Desinformation bei, so die Kritik. Neuere Studien weisen jedoch darauf hin, dass der Effekt deutlich schwächer sein könnte als gedacht, wie auch das Online-Magazin netzpolitik.org berichtet.

Youtube und Facebook unter Druck

Wissenschaftlich nachzuweisen, wie sich solche automatischen Auswahlmechanismen auf das Verhalten der Nutzer auswirken, sei kompliziert, sagt der Kommunikationswissenschaftler Jonas Kaiser. Der Forschungsstand zum Thema biete ein dementsprechend diffuses Bild.

Kaiser selbst hat am Berkman Klein Center für Internet und Gesellschaft der Universität Harvard unter anderem Formen der Radikalisierung auf Youtube untersucht. Unternehmen wie Youtube und Facebook stünden zunehmend unter öffentlichem Druck und versuchten daher durchaus, dem Verdacht entgegenzuwirken, sie würden junge Menschen radikalisieren, sagt er.

Algorithmus verändert, Kanäle gesperrt

So habe Youtube 2019 beispielsweise den Auswahl-Algorithmus verändert. Dieser ziele nun nicht mehr auf die reine Verweildauer der Besucherinnen und Besucher ab, sondern stärker darauf, sie durch die empfohlenen Inhalte so gut wie möglich zufriedenzustellen. Dem Unternehmen zufolge habe die Zahl besonders problematischer Videos, die konsumiert würden, seitdem tatsächlich abgenommen.

Dazu hätten aber vermutlich noch weitere Maßnahmen beigetragen, sagt Kaiser, zum Beispiel gezielte Schritte von Youtube gegen Desinformation sowie das Löschen von Kanälen mit radikalen Inhalten.

Verschwörungsideologen in den USA

Bei der Suche nach den Ursachen für politische Radikalisierung diene der "Rabbit-Hole-Effekt" häufig als "ein Sündenbock, den man hervorholen kann, um schwierigere Diskussionen zu vermeiden", meint Kaiser. Manchmal erscheine es eben einfacher, dem Internet oder einzelnen Algorithmen die Schuld zu geben, als über Reformen der Waffengesetze zu sprechen oder darüber, wie stark Verschwörungsideologien in den USA inzwischen auch über sogenannte Mainstream-Medien wie Fox News Verbreitung fänden.

(fka)