Volksverhetzung in unverfänglichen Playlists

11:20 Minuten

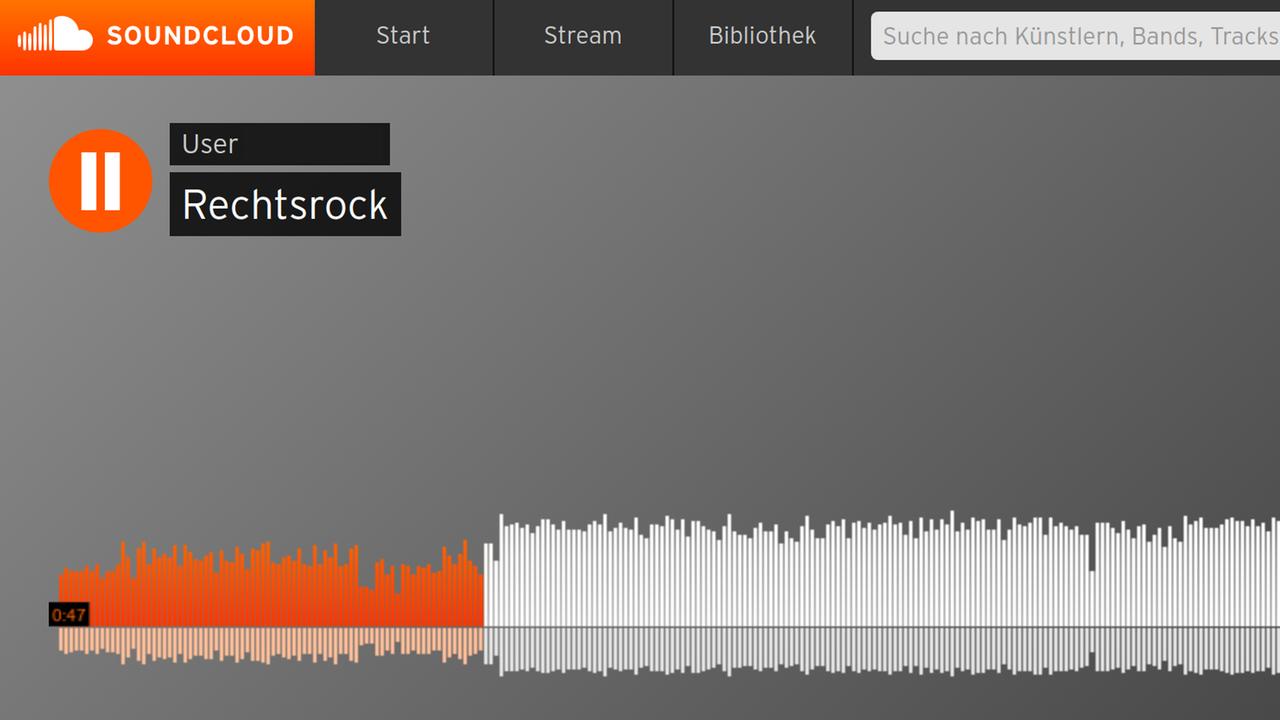

Rechtsrock und weitere Neonazi-Inhalte sind auf Soundcloud leicht zu finden und tauchen zum Teil auch in unscheinbaren Playlists auf. Die Plattform unternehme dagegen zu wenig, sagt der Journalist Sammy Khamis nach Recherchen für Dlf Kultur.

Vivian Perkovic: Böse Menschen haben keine Lieder. Das wird zwar schon seit dem frühen 19. Jahrhundert behauptet und auch gesungen, stimmt aber nicht. Nicht damals und auch nicht heute.

Rechte Inhalte zum Beispiel werden sehr zielgruppengemäß auch über Songs verbreitet. Mit Musik und Musikevents kommen Rechtsextreme eben gut an junge Menschen ran. Das passiert nicht nur über Konzerte und Festivals, sondern auch auf sozialen Plattformen im Netz, auf Youtube zum Beispiel.

Aber gerade, was rechte und rechtsextreme Musik angeht, ist auch ein deutsches Unternehmen in den Fokus geraten: die Streaming-Plattform Soundcloud – gegründet in Berlin und eigentlich ein Vorzeigeunternehmen, Start-up aus Deutschland, Sprungbrett für verschiedene Künstler und Künstlerinnen, die dort groß wurden. Soundcloud ist nach eigenen Angaben die größte Audio- und Streaming-Plattform der Welt mit 175 Millionen Streams im Monat, Stand 2015.

Soundcloud ist aber auch ein soziales Netzwerk. Künstler und Künstlerinnen laden ihre Tracks dort direkt hoch, Nutzer können kommentieren, Playlists kreieren, aber – und das zeigten die Recherchen von Deutschlandfunk Kultur – Soundcloud ist auch zu einem Tummelplatz für rechte Inhalte und Musik geworden. Dazu hat unser Kollege Sammy Khamis recherchiert. Sammy, zuerst einmal: Wie sind Sie überhaupt drauf gekommen, dass es auf Soundcloud viele rechte Songs gibt?

Neonazis in der Rock-Playlist

Sammy Khamis: Das war mir schon länger bekannt, aber ein Kollege hat uns an die Redaktion einen Screenshot geschickt, und zwar einen Screenshot einer Playlist, die er sich anhörte – da war so 90er-, 2000er-Jahre-Rock dabei, Linkin Park, Nirvana und so weiter. Und in dieser eigentlich unverfänglichen Playlist tauchten dann auf einmal auf Böhse Onkelz, danach Kategorie C, das ist eine Hooligan-Band, und Landser, eine 90er-Jahre-Neonazi-Band.

Das war dann der Ausgangspunkt der Recherche, zu fragen: Welche Inhalte finden sich denn überhaupt auf Soundcloud, sind verbotene und indizierte Tracks darunter? Und die Frage: Was macht Soundcloud dagegen?

Perkovic: Was haben Sie denn da herausgefunden?

Khamis: Zuerst einmal, auf Soundcloud finden sich sehr viele rechte, rechtsextreme, volksverhetzende und teilweise indizierte Songs. Es ist relativ schwer zu quantifizieren, aber es sind wirklich viele. Wenn man fünf Minuten im Suchfenster verbringt, dann kommt man sehr schnell auf diese rechten Inhalte.

Man findet dann, sag ich mal, rechtsextreme Klassiker, in Anführungsanzeichen, Musik aus der Nazizeit selbst, Soldatenlieder – das Horst-Wessel-Lied ist darunter –, aber auch Songs, die seit den 1990er-Jahren indiziert und deren Verbreitung damit ja verboten ist in Deutschland.

Es gibt aktuelle rechte Inhalte, die erst vor Kurzem verboten wurden, und es gibt unzählige Bilder von Hakenkreuzen, SS-Runen, Hitler-Porträts, eigene Hashtags wie Siegheil. Und neben diesen alten Skinhead-, Neonazi- und Nazisachen finden sich – und das ist auffällig – auf Soundcloud auch neue Inhalte der Alt-Right-Szene, amerikanisch geprägter Neonazismus sozusagen.

Musik gewordener Springerstiefel-Sound

Perkovic: Haben Sie da Beispiele für indizierte und verbotene Musik?

Khamis: Ja, wir haben uns entschieden, die nicht zu spielen, aber es gibt sie auf Soundcloud. Wir wollen sie hier in der Sendung nicht noch mal reproduzieren, dem nicht noch eine größere Plattform bieten. Auf Soundcloud finden sich, sagen wir mal, so ganz klassischer Rechtsrock, viel Lärm, Genozidfantasien ins Mikrofon geschrien, Bands wie Landser, Stahlgewitter, Skrewdriver, das ist Musik gewordener Springerstiefel-Sound, sag ich mal, aus den 90er-Jahren.

Vieles, was wir unter Rechtsrock kennen, ist heute noch auf der Plattform zu finden. Das ist indizierte Musik, also von der Bundesprüfstelle für jugendgefährdete Medien als jugendgefährdend oder volksverhetzend eingestuft, unter anderem wegen der Genozidfantasien, wegen dem offenen Hass auf Jüdinnen und Juden.

Ein Beispiel, das ich gefunden hab, war zum Beispiel der Song "Auftrag Deutsches Reich", im Refrain hört man dann mehrmals die Heil-Rufe, und kurz danach "Unsere Heimat ist das Deutsche Reich" und so weiter. Also, die Bundesrepublik und demokratische Grundordnung, die wird da überhaupt nicht anerkannt. Der Song war auf Soundcloud sehr leicht zu finden.

Er tauchte auch – und das ist quasi das Gefährliche – in einer Playlist eines Users auf, der Songs zusammengestellt hat wie Ed-Sheeran-Songs, also so Megahits, und Deutsch-Rapper wie Bonez MC, die eigentlich mit rechter Musik nichts zu tun haben. Dadurch, dass es in diesen Playlists ist, taucht dieser Sound, dieser rechte Sound bei jungen Leuten auf, die sich diese Playlist eigentlich unverfänglich anhören wollen.

Neben diesem indizierten Rechtsrock gibt’s auch deutschen Rap zum Beispiel, der indiziert ist, auf Soundcloud, Hitler-Reden, original alte Soldatenlieder der Nazis, also zahlreiche in Deutschland verbotene Inhalte.

Perkovic: Können Sie sich das erklären, wie das passiert, dass – ein Algorithmus, der wahrscheinlich dahintersteckt – in einer Playlist von jemandem, der offensichtlich keinen Rechtsrock hört und hören möchte, dann solche Lieder auftauchen?

Soundcloud verlässt sich auf Meldungen von Nutzern

Khamis: In der Regel werden diese Playlists bewusst von den Nutzerinnen und Nutzern zusammengestellt, aber der Algorithmus spielt auch eine Rolle. Soundcloud, zum Beispiel wenn man da einen Rechtsrocksong hört, schlägt einem weitere rechte Musiktitel vor, und das ist nicht ohne. Wenn ich mir einen Song anhöre, dann komm ich da wahrscheinlich aus diesem Strudel nicht so leicht raus, beziehungsweise mir werden immer weitere Songs vorgeschlagen, und zwar extremistische Inhalte. Da ist Soundcloud auf alle Fälle in der Pflicht, sagen Kritikerinnen und Kritiker, nachzubessern.

Perkovic: Soundcloud schreibt auf seiner Homepage ja, Meinungsfreiheit sei im Soundcloud-Sinne, und dann ist es jedoch nicht gestattet, Soundcloud zu nutzen, um illegale Inhalte und Inhalte in Verbindung mit extremistischen Ideologien zu teilen. Solche Inhalte, wenn sie gemeldet würden, würden gelöscht und die Profile der User gleich mit. Stimmt das?

Khamis: Das stimmt, und das ist auch so ein bisschen das Problem, weil in anderen Worten, outsourct Soundcloud die Arbeit, extremistische Inhalte zu melden, an die eigenen Nutzerinnen und Nutzer, an die Community, wie Soundcloud sagt. Das heißt, Soundcloud sieht es nicht als eigene Aufgabe, aktiv, proaktiv nach diesen Inhalten zu suchen und sie zu entfernen, sondern das lässt man dann die Nutzerinnen und Nutzer machen.

Perkovic: Und funktioniert wenigstens das? Also wenn etwas gemeldet wird, entfernt Soundcloud das dann?

Khamis: Ich hab’s ausprobiert mit dem Song, den wir angesprochen haben, mit den Heil-Rufen im Refrain, der war dann tatsächlich innerhalb von 24 Stunden gelöscht, das Nutzerprofil auch. Das muss auch so funktionieren, Stichwort Datenschutz-Grundverordnung. Wenn Hass und Hetze auf Plattformen geteilt wird, das wird gemeldet, und es würde nicht gelöscht, dann drohen ja auch Millionen-Strafen. Trotzdem, die Songs, die ich gefunden habe, die indiziert und in Deutschland verboten waren, die ich nicht gemeldet habe an Soundcloud, die sind weiterhin zu finden dort.

Werbung vor einer Hitler-Rede

Perkovic: Jetzt haben Sie bei Soundcloud ja auch nachgefragt und wollten wissen, wie viele Personen denn mit dem Löschen von Inhalten beschäftigt sind. Wie ernst nimmt das Unternehmen das Problem, und was will es denn gegen diese zahlreichen rechte Inhalte unternehmen?

Khamis: Soundcloud hat genau diese Fragen von mir bekommen. Ich hab keine Antwort auf meine detaillierte Anfrage erhalten. Vor zwei Jahren, 2018, hatten die Kolleginnen und Kollegen des Online-Magazins "Vice" ebenfalls über das Thema berichtet. Und da schickte Soundcloud dann ein Statement, in dem es hieß, Zitat: "Soundcloud verbietet gesetzeswidrige Inhalte eindeutig in den Nutzungsbedingungen." Und weiter: "Wir verlassen uns auf unsere Community-Mitglieder, um diese Inhalte zu kennzeichnen. Sobald die Inhalte gemeldet werden, prüft unser spezielles Trust-and-Safety-Team mit Sitz in Berlin die Inhalte."

Das heißt jetzt das, was wir auch schon gesagt haben: Soundcloud sagt, wir kennen das Problem, aber die Community soll sich drum kümmern. Wie viele Leute das löschen, weshalb zum Beispiel Werbung vor einer Hitler-Rede eingeblendet wurde – das ist auch in meiner Recherche aufgetaucht – weshalb Soundcloud keine künstliche Intelligenz oder Upload-Filter verwendet, um verbotene Inhalte schon während des Uploads rauszufiltern, darauf haben wir eben keine Antwort bekommen, weil Soundcloud da nichts zu sagen wollte.

Perkovic: Wohin sind Sie denn mit Ihren Recherchen dann noch gegangen?

Khamis: Zur Bundesregierung. Ich haben den Antisemitismusbeauftragten der Bundesregierung, Felix Klein, befragt und auch die Recherchen gezeigt. Felix Klein sagte, er sei schockiert über die eindeutig antisemitischen Inhalte auf Soundcloud, und er sagte auch, selbst wenn Soundcloud nach Datenschutz-Grundverordnung löscht, reicht das nicht aus.

Die Plattform könne aktiv nach solchen antisemitischen Inhalten suchen und sie auch entfernen. Die AGBs von Soundcloud geben das her, meint der Antisemitismusbeauftragte, und Soundcloud solle genauer hinschauen. Ähnlich äußern sich auch Benjamin Strasser, Bundestagsabgeordneter der FDP, und RIAS, die Recherche- und Informationsstelle Antisemitismus. Beide sagen, Soundcloud muss proaktiv gegen diese Inhalte vorgehen.

Perkovic: Diese angesprochenen Menschen, also Antisemitismusbeauftragter und die anderen Stellen, die können Soundcloud jetzt auch nicht rechtlich dazu bringen, von sich aus diese rechten Inhalte zu löschen, oder?

Khamis: Nee, das hat damit zu tun, dass Soundcloud eine Plattform ist, die keinen eigenen Content hochlädt. Das ist die Argumentation, weshalb man die nicht zwingen kann, das zu löschen. Aber Facebook, Youtube und Twitter machen vor, dass man mehr unternehmen kann, dass man auch aktiv Inhalte, die gegen Nutzungsbedingungen verstoßen, löschen kann. Das ist möglich, Soundcloud macht es nicht.

Das Wort "oven" als Code für den Holocaust

Perkovic: Eine Sache sind ja jetzt die eindeutig gesetzeswidrigen Songs auf Soundcloud, also alles, was zum Beispiel indiziert ist. Was ist denn mit den anderen Inhalten, die vielleicht rechtsradikal oder aus der rechten Ecke kommen, aber eben nicht verboten sind?

Khamis: Es gibt eine relativ spannende Sache, die in der Recherche noch aufgefallen ist, und zwar eine Art rechtsextreme Subkultur, die auf der Plattform existiert und die sehr stark in Codes spricht. Das ist vor allem diese amerikanische Alt-Right-Bewegung. Wenn man sich deren Songs anhört, sind es häufig Cover, die Wörter benutzen wie "oven", also Ofen, und das als Code verwenden für den Holocaust. Das ist nicht wirklich subtil, aber das ist deren Sprache.

Aus diesem Wort entstehen dann unterschiedliche rechte Mains, die zum Genozid aufrufen, und ganz häufig in Form amerikanischer Popsongs, die sie dann covern. Ein Beispiel den Song "Get this Party started" von Pink, das war mal ein Hit, vielleicht erinnert sich noch der ein oder andere dran. Da gibt es einen Cover-Song, der das Wort Party mit dem Wort "oven" austauscht. Und relativ viele dieser Coversongs finden sich heute auf Soundcloud. Die waren zuvor auf den anderen Plattformen Facebook, Youtube und Twitter zu finden, sind dort aber dann ab Ende 2018 aktiv gelöscht worden, weil sie eben gegen Hassrede, Hate Speech verstoßen. Sie haben einfach sehr streng ihre Nutzungsbedingungen durchgesetzt, und in diesen Nutzungsbedingungen steht drin, wer zu Menschenhass aufruft, der wird gelöscht, und zwar dessen Inhalt und dessen Profil.