Hände weg von autonomen Drohnen!

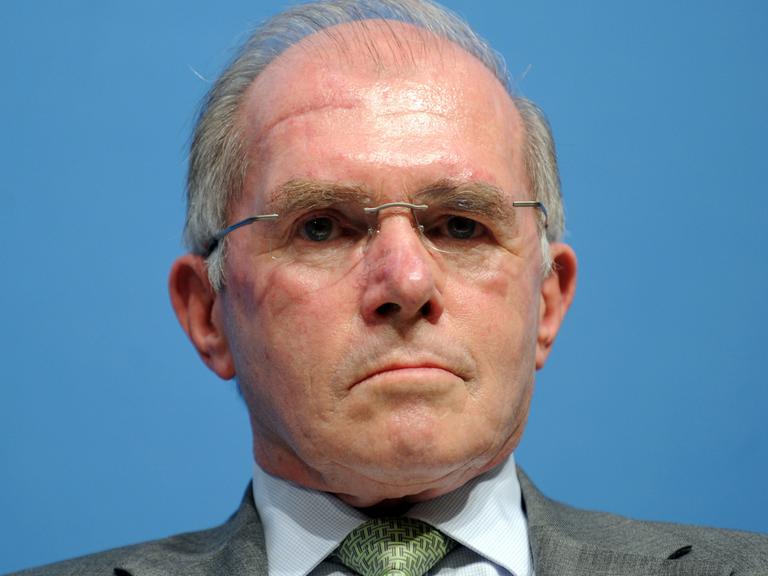

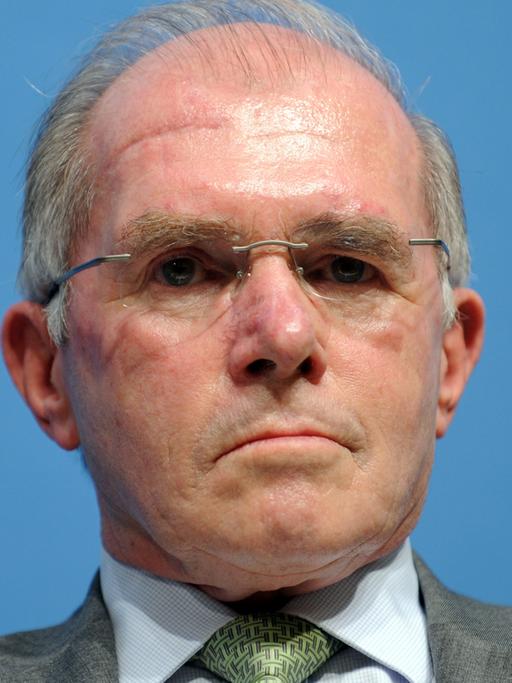

Die Vereinten Nationen beraten ab heute wieder in Genf über autonome Waffensysteme. Experten wie Karsten Weber von der Universität Cottbus warnen eindringlich vor Kampfdrohnen, die über den Waffeneinsatz eigenständig entscheiden.

Der Technikspezialist Karsten Weber von der Universität Cottbus-Senftenberg hat vor autonomen Waffensystemen gewarnt und deren internationales Verbot gefordert. Im Deutschlandradio Kultur sagte Weber, auch bei anderen Waffensystemen wie Landminen oder Streumunition sei es gelungen, sie zu weitgehend verbannen. Man könne jetzt nur hoffen, dass ähnliche Initiativen in Bezug auf autonome Waffensysteme Erfolg hätten, betonte er. "Denn es würde im Vorfeld etwas verhindern, was wir im Nachgang (...) dann womöglich bereuen würden", sagte er. Im Blickfeld der Debatte sind vor allem Drohnen, die über den Einsatz ihrer Waffen eigenständig entscheiden. Gegner solcher Waffensysteme argumentieren, dass diese über kein moralisches Empfinden verfügen. Zudem könne nur der Mensch die Verantwortung für den Einsatz einer Waffe übernehmen. Ein Multimedia-Feature zum Thema finden Sie hier.

Das Gespräch im Wortlaut:

Dieter Kassel: Zwei Mal geht es bei uns heute morgen um Dinge, die mit moderner Software gesteuerte Maschinen scheinbar besser können als Menschen, und darum, ob das gut oder schlecht ist. Wir werden in ungefähr einer Dreiviertelstunde über Industrieroboter reden, jetzt aber geht es um etwas sehr viel Heikleres.

Ab heute beraten die Vereinten Nationen in Genf über autonome Waffensysteme, Maschinen also, die Menschen töten – in den Nachrichten tauchen sie seit geraumer Zeit unter dem Begriff Kampfdrohnen auf. Und über solche Drohnen wollen wir jetzt mit Karsten Weber sprechen, er ist Professor für Allgemeine Technikwissenschaften an der Brandenburgischen Technischen Universität Cottbus-Senftenberg und beschäftigt sich insbesondere mit Technikethik. Schönen guten Morgen, Professor Weber!

Karsten Weber: Guten Morgen!

Kassel: Stimmt es überhaupt, was ich gerade behauptet habe? Töten Drohnen besser als Menschen?

Weber: Na ja, sie sind auf jeden Fall relativ günstig im Vergleich dazu, wenn man Menschen einsetzt. Ob sie besser töten, wenn man diese Steigerungsform wirklich in diesem Zusammenhang anwenden möchte, das kann ich tatsächlich nicht so gut beurteilen.

Kassel: Aber um welche Waffensysteme geht es überhaupt? Was ist ein autonomes Waffensystem?

Weber: Ein autonomes Waffensystem ist eines, das im Einsatz selbst entscheidet, wann die Waffen eingesetzt werden, und zwar nicht nur einfach nach irgendwelchen automatischen Abläufen, nach dem Motto, ich bin jetzt am Ziel angekommen, ich bin in der richtigen Höhe, wenn zum Beispiel eine Drohne ist, und ich werfe jetzt meine Bombe ab, sondern: Aha, da ist jetzt das Ziel, aha, da sind jetzt auch die Leute, von denen man vermutet, dass sie dort sind, ich bin jetzt in der richtigen Position, aha, ich kann auch erkennen, keine Zivilisten sind in der Nähe – jetzt werfe ich die Waffe ab.

Kassel: Theoretisch. Praktisch habe ich aber immer wieder Nachrichten gehört von Drohnenangriffen, bei denen durchaus Zivilisten zu Schaden kamen.

Drohnen: Noch drückt der Mensch auf den entscheidenden Knopf

Weber: Ja. Man muss allerdings auch noch hinzufügen, dass das keine wirklichen autonomen Drohnen sind, denn bisher zumindest ist immer ein Mensch dabei, der die Entscheidung trifft, ob die Waffe wirklich ausgelöst wird oder nicht. Zwar vollziehen die Drohnen teilweise den Anflug autonom und auch viele andere Dinge, aber nicht wirklich den Waffeneinsatz. Hier würde man eher von halbautonomen Waffensystemen sprechen.

Kassel: Wenn über diese schon im Einsatz befindlichen halbautonomen Systeme oder auch über die vollautonomen der Zukunft geredet wird, über die moralischen Implikationen, dann habe ich oft das Gefühl: Es klingt ein bisschen so, als sei es, wenn Maschinen Menschen töten, schlimmer, als wenn Menschen Menschen töten. Das scheint mir ein bisschen simpel.

Weber: Ja, weil man einfach argumentiert, dass ein moralisches Empfinden und eine Abwägung zum Beispiel eben nur Menschen vollziehen können, dass das nicht mit Maschinen möglich wäre, dass eine Programmierung solcher ethischen Grundsätze, beispielsweise der Unterscheidung von Zivilisten und Kombattanten, nicht möglich wäre. Und der andere Aspekt ist, dass man argumentiert, dass nur ein Mensch verantwortlich sein kann für seine Taten und dann gegebenenfalls auch zur Rechenschaft gezogen werden kann, wenn Entscheidungen und Handlungen eben aus ethischer Perspektive sich als falsch erweisen.

Kassel: Wenn Menschen Menschen töten, ist das zwar schrecklich, aber damit haben wir ja nun eigentlich Jahrtausende alte Erfahrung schon. Da gibt es auch – die sind noch nicht so alt, aber auch nicht mehr neu – verbindliche, völkerrechtliche Regelungen. Sind die eigentlich auch ausreichend für einen Drohnenkrieg?

Moral kann man nicht programmieren

Weber: Wenn man sie einsetzen könnte oder beziehungsweise wenn man sie umsetzen könnte, würden sie vermutlich ausreichen, den Krieg, na ja, human zu gestalten. Die vielen Initiativen, die sich gegen den Einsatz von vollautonomen Systemen wenden, argumentieren aber, dass es diese Möglichkeit nicht gibt, dass man also technisch die Möglichkeiten, die Menschen haben, moralisch zu urteilen und entsprechend verantwortlich zu handeln, eben nicht umsetzen kann in Technik und deswegen auch diese ganzen Forderungen der entsprechenden Kriegsführung nicht technisch umsetzen kann und damit eben zu einem wesentlich inhumaneren Krieg kommen würde.

Kassel: Ich sehe eine Gefahr schon jetzt bei den halbautonomen Systemen und ich bin mir nicht sicher, ob das bei vollautonomen Systemen besser wird: Ich hoffe zwar, dass Netzwerke, über die Drohnen gesteuert werden, ein bisschen besser gesichert sind als Netzwerke französischer Fernsehsender, aber wir haben nun schon in mehreren Fällen – auch bei sehr viel heikleren Sachen als TV 5, was ich jetzt natürlich gerade meine – erlebt, dass Systeme fremdgesteuert wurden. Wir reden da teilweise sogar von einem Cyberkrieg. Ist es nicht denkbar, dass eine Drohne zwar von Washington aus eingesetzt wird, aber am Ende zum Beispiel – es ist tatsächlich nur ein Beispiel – gar nicht mehr vom amerikanischen Militär gesteuert wird?

Zielpersonen versuchen, die Kampfdrohne zu kapern und umzusteuern

Weber: Ja, das ist ohne Zweifel ein durchaus realistisches Szenario, und zwar wird über solche Dinge nicht allzu freiwillig berichtet, allerdings: Man hört immer mal wieder, dass die potenziellen Zielpersonen oder auch Zielgruppen durchaus versuchen, Kampfdrohnen zu übernehmen durch entsprechende technische Maßnahmen, um sich damit eben auch davor zu schützen. Man könnte aber auch umgekehrt sagen, dann werden diese Maschinen gekapert und womöglich gegen die eingesetzt, die sie losgeschickt haben. Also das ist zumindest eine realistische Möglichkeit. In welchem Umfang sie umgesetzt werden kann, ist dann noch mal eine andere Frage.

Kassel: Was würden Sie angesichts dieser vielen Bedenken, die Sie geäußert haben – wir könnten wahrscheinlich noch mehr finden – den Vereinten Nationen empfehlen? Glauben Sie, man kann den Einsatz von Drohnen sinnvoll verbindlich regeln oder wären Sie eher für eine Art Moratorium?

Weber: Na ja, es ist bei manchen anderen Waffensystemen auch gelungen, sie zu verbannen und tatsächlich auch dabei eine relativ breite Mehrheit auf der Welt zu finden von Ländern, die sich dem angeschlossen haben, Landminen, Streumunition beispielsweise. Insofern ist der Versuch ... Den Versuch kann man nur unterstützen und man kann eigentlich nur hoffen, dass dabei Erfolg rauskommt, denn es würde im Vorfeld etwas verhindern, was wir im Nachgang, wenn dann diese Waffen massiv eingesetzt würden von allen Seiten, was wir womöglich dann bereuen würden. Und, ja, vielleicht könnte man da eben schon klüger sein und im Vorfeld etwas dagegen tun. Das wäre wirklich nur zu wünschen.

Kassel: Etwas Optimismus am Schluss jetzt noch von Karsten Weber, Professor für Allgemeine Technikwissenschaften an der Technischen Universität Cottbus-Senftenberg. Herr Weber, ich danke Ihnen sehr für das Gespräch!

Weber: Danke, vielen Dank!

Äußerungen unserer Gesprächspartner geben deren eigene Auffassungen wieder. Deutschlandradio Kultur macht sich Äußerungen seiner Gesprächspartner in Interviews und Diskussionen nicht zu eigen.